ChatGPT : Künstliche Intelligenz ?

Toutes les formations actuelles pour enseignants ne parlent plus que d’intelligence artificielle et de la merveille ChatGPT que la Forma OPENAI américaine a déposée sur notre table de Noël. Et l’anonymat des textes déteint déjà sur les manifestations qui veulent nous expliquer le robot vocal. Les participants ne sont souvent pas montrés du tout et, comme cela s’est encore produit récemment, les questions des participants via le chat ne sont signalées que par un F. pour question.

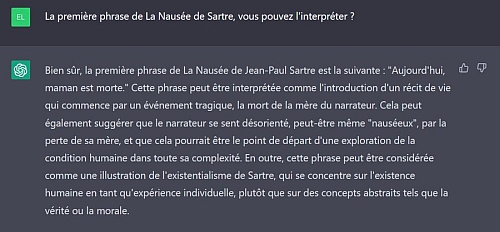

Mise à jour le 5.4.2023 : Récemment, notre rédaction a proposé à ChatGPT de répondre, en tant que député RN, à nos questions sur toutes sortes de sujets politiques ; nous ne reproduisons pas ici l’interview, mais bien l’enseignement que l’on peut en tirer quant à la qualité des réponses de ChatGPT : cette hallucination, cette connerie, on ne sait pas quand et à quelle occasion cela passera au sérieux, bref, ChatGPT est insensé au sens noble du terme, donc inutilisable, n’est-ce pas ? C’est justement pour les sujets politiques qu’il est très inquiétant qu’aucun auteur des sujets proposés par ChatGPT n’apparaisse. Oui, on pourrait presque penser que les textes du bot se présentent comme des chevaux de Troie qui portent en eux des faked facts, d’où notre question : quand le passage de la stupidité au sérieux devient-il reconnaissable ?

> ChatGPT – brauchen wir nun eine neue Fachdidaktik für Französisch? – 2 février 2023

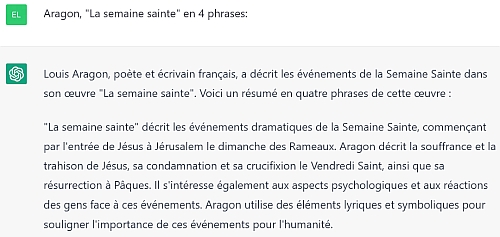

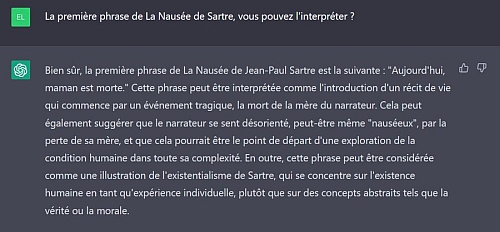

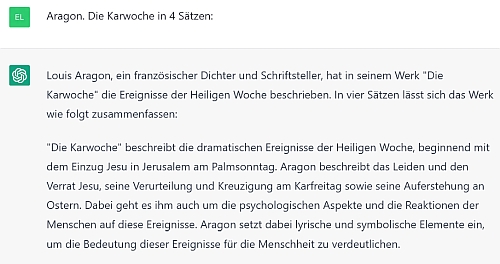

Cette fois-ci, l’insistance sur la question de savoir si ChatGPT contenait vraiment de l'“intelligence artificielle“ a finalement porté ses fruits. L’un des participants à la table ronde a admis que l’IA était un mot à la mode qui, parce qu’il était introduit, était également utilisé. La vraie question sur le contenu IA de ChatGPT est restée ouverte. Qu’est-ce qui justifie de qualifier ChatGPT d’intelligence artificielle ? N’est-ce pas un peu trop ambitieux ? Que peut faire ChatGPT que les humains ne peuvent pas faire ? ChatGPT a-t-il un autre avantage que celui d’être plus rapide que l’homme ? Le problème est très similaire à celui de Wikipédia : on ne connaît pas les auteurs des entrées de l’encyclopédie ; on prend connaissance de leur contenu et on s’en remet sans trop réfléchir à l’intelligence du groupe, qui n’est pourtant pas si intelligente que ça au vu de certaines erreurs à faire dresser les cheveux sur la tête :

Entre-temps, mes élèves ont déjà lu un texte rédigé par le modèle linguistique. J’avais distribué ce texte avec une mauvaise conscience, car un tel texte, rédigé de manière anonyme, porte atteinte au principe auteur-texte. Il s’agit d’une dévalorisation irresponsable du principe selon lequel les textes sont rédigés par des auteurs qui en portent également la responsabilité. Mes élèves pourraient indiquer ChatGPT comme auteur des textes créés par la machine, ce qui ne résout en aucun cas le problème de la responsabilité, de la qualité d’auteur du texte.

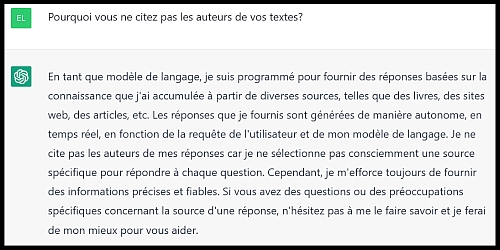

Après tout, ChatGPT est bien conscient qu’il ne cite pas ses sources. donc sa valeur scientifique tend vers zéro. Les efforts de le sauver pour l’emploi dans le cadre d’un travail scientifique n’auront aucun succès : Sans les données sources, les résultats de ChatGPT ont encore moins de valeur que les articles anonymes de Wikipédia.

L’apparition fortuite d’un texte en raison des corrélations statistiques n’a rien à voir avec l’apparition d’un texte sous la plume de son auteur. Bien sûr, il n’est nullement nécessaire de connaître la biographie d’un auteur pour comprendre son œuvre, mais ce que Sartre a dit de l’auteur et du lecteur dans Qu’est-ce que la littérature?, à savoir que ce n’est que de leur effort commun que peut émerger cet objet imaginaire qui est l’œuvre de l’esprit, reste valable. Si l’auteur est une machine, il n’a pas d’intention, il ne peut donc pas se connecter à l’intelligence du lecteur, car la machine ne porte en elle que de nombreux mots dont la composition est guidée par des algorithmes, des statistiques, voire des hasards, mais jamais par la conscience et le style. Même un stagiaire d’un journal local mettra plus de sa propre attitude, de ses connaissances et de ses intentions dans un texte que ChatGTP ne le peut. Les admirateurs du langage artificiel avide de voir que le nouveau langage puisse remplacer le langage humain seront peut-être décus s’ils regardent de plus près ce que le ChatGPT et ses frères et sœurs nous proposent. Répétons, ChatGPT ne peut pas penser, il calcule, il cherche des probabilités pour répondre à une question qu“on lui pose. Gustave Flaubert procédait tout différemment en se faisant auteur, ce que Jean-Paul Sartre a analysé sur 2801 pages: son langage, son imaginaire, sa manière de vaincre ses névroses: ChatGPT est loin de toute imagination v. la tribune Eric Sadin: ChatGPT : « Plus que dans un capitalisme de surveillance, nous voici dans une administration de notre bien-être », dans LE MONDE 19.1.2023

Eric Sadin,“En matière d’IA, l’éthique est une imposture„, tribune à propos de l’usage si galvaudé que font la plupart des ingénieurs du numérique de la notion d'“éthique“. – Le Figaro, le 9 février 2023.

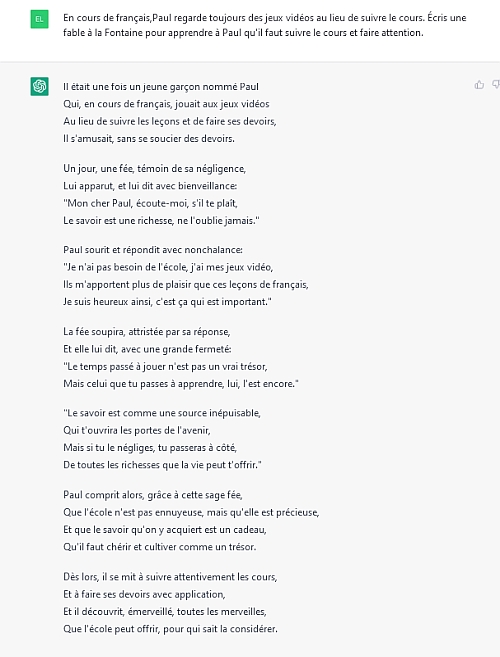

Dans les formations continues portant sur ChatGPT, des voix s’élèvent actuellement pour demander que l’on ne se contente plus de regarder les résultats des travaux des élèves, mais que l’on s’intéresse aussi au chemin parcouru pour y parvenir et que l’on évalue ce chemin. Est-ce une façon de contourner la tricherie à l’aide de ChatGPT ? En fait, un problème peut se poser pour l’évaluation des devoirs, car ChatGPT peut fournir des textes sur commande sur des sujets précis. Or, l’Internet regorge de textes qui pourraient également se retrouver sous forme de morceaux dans des exposés. Le problème n’est donc pas si nouveau.

Dans les formations continues portant sur ChatGPT, des voix s’élèvent actuellement pour demander que l’on ne se contente plus de regarder les résultats des travaux des élèves, mais que l’on s’intéresse aussi au chemin parcouru pour y parvenir et que l’on évalue ce chemin. Est-ce une façon de contourner la tricherie à l’aide de ChatGPT ? En fait, un problème peut se poser pour l’évaluation des devoirs, car ChatGPT peut fournir des textes sur commande sur des sujets précis. Or, l’Internet regorge de textes qui pourraient également se retrouver sous forme de morceaux dans des exposés. Le problème n’est donc pas si nouveau.

Le modèle linguistique est venu pour rester et on s’attend à une évolution mouvementée, chacun voulant constamment être en tête comme dans une course de chevaux. Et on compare son apparition à celle de la calculatrice, à laquelle on s’est habitué. Ma calculatrice était en effet plutôt un outil qui ne servait pas à grand-chose si l’on ne comprenait pas l’exercice et la méthode de résolution. L’un de mes élèves, qui avait réalisé son devoir à l’aide de ChatGPT et qui s’était bien sûr fait remarquer parce qu’il n’avait jamais apporté un texte aussi long en français, a su le lire à haute voix et le traduire de manière remarquable. Il avait cherché et trouvé de l’aide et, pour que cela ne se remarque pas, il avait appris tout le vocabulaire et n’avait sans doute jamais travaillé aussi longtemps et avec autant de succès sur un devoir. Et quelle note lui donner ?

Encore un exemple:

Quelles œuvres Hans Mayer (1907-2001) a-t-il traduites ?

ChatGPT: „Hans Mayer était un écrivain, critique littéraire et traducteur allemand qui a traduit de nombreux ouvrages de l’anglais vers l’allemand au cours de sa carrière. Voici quelques-unes des œuvres les plus connues qu’il a traduites :

„Ulysse“ de James Joyce (en allemand : „Ulysses“)

„La Terre vaine“ de T.S. Eliot (en allemand : „Das wüste Land“)

„Le Bruit et la Fureur“ de William Faulkner (en allemand : „Schall und Wahn“)

„Pour qui sonne le glas“ d’Ernest Hemingway (en allemand : „Wem die Stunde schlägt“)

„L’Amant de lady Chatterley“ de D.H. Lawrence (en allemand : „Lady Chatterleys Liebhaber“)

Il est important de noter que Mayer était également actif en tant que critique littéraire et auteur en allemand, et a publié de nombreux livres et essais dans sa langue maternelle.“

ChatGPT aurait mieux fait de regarder ici : Hans Mayer als Übersetzer www.hans-mayer-gesellschaft.de

Alle aktuellen Lehrerfortbildungen sprechen nur noch von Künstlicher Intelligenz und dem Wunderwerk ChatGPT, das uns die amerikanische Firma OPENAI auf den weihnachtlichen Gabentisch gelegt hat. Und die Anonymität der Texte färbt schon auf die Veranstaltungen ab, die uns den Sprachroboter erklären wollen. Die Teilnehmer werden oft gar nicht gezeigt und wie kürzlich gerade bei einer solchen Gelegenheit wieder geschehen, werden Fragen der Teilnehmer via Chat ohne Namen nur mit einem „F.“ für Frage gekennzeichnet.

Aktualisiert am 5.4.2023: Kürzlich hat unsere Redaktion ChatGPT vorgeschlagen, als Abgeordneter des RN unsere Fragen zu allen möglichen politischen Themen zu beantworten beantworten; wir geben das Interview hier nicht wieder, aber sehr wohl die Erkenntnis, die daraus bezüglich der Qualität er Antworten von ChatGPT gezogen werden kann: diese Halluzination, dieser Schwachsinn, man weiß nicht, wann und bei welcher Gelegenheit das in den Ernstfall übergeht, kurz, ChatGPT ist im besten Sinne des Wortes unsinnig, also unbrauchbar, nicht wahr? Gerade bei politischen Themen ist es sehr bedenklich, dass kein Autor der von ChatGPT vorgeschlagneen Themen erscheint. Ja, man könnte fast meinen, dass die Texte des Bots wie Trojanische Pferde daherkommen, die faked facts in sich tragen, daher rührt unsere Frage, wann der Übergang von der Dummheit zur Seriosität erkennbar wird:

> ChatGPT – brauchen wir nun eine neue Fachdidaktik für Französisch? – 2. Februar 2023

Dieses Mal hatte das Insistieren darauf, ob ChatGPT wirklich „Künstliche Intelligenz“ enthalte, endlich einmal Erfolg. Einer der Teilnehmer auf dem Podium gab zu, dass KI ein Modewort sei, das, weil es nun einmal eingeführt sei, auch verwendet werde. Die eigentliche Frage nach dem KI-Gehalt von ChatGPT blieb dabei offen. Was berechtigt denn, ChatGPT als Künstliche Intelligenz zu bezeichnen? Ist das nicht etwas zu hoch gegriffen? Was kann denn ChatGPT, was Menschen nicht können? Gibt es bei ChatGPT einen anderen Vorteil als den, schneller als der Mensch zu sein? Das Problem ist ganz ähnlich, wie bei Wikipedia: man kennt die Autoren der Lexikoneinträge nicht; nimmt man ihre Inhalte zur Kenntnis, verlässt man sich ohne besonders nachzudenken auf die Schwarmintelligenz, die aber angesichts so mancher haarsträubender Fehler gar nicht so intelligent ist:

Mittlerweile haben meine Schüler auch schon einen von dem Sprachmodell verfassten Text gelesen. Mit einem schlechten Gewissen hatte ich den Text ausgeteilt, denn so ein anonym verfasster Text beschädigt nun mal das Prinzip Autor-Text frei nach Foucault. Es handelt sich um eine verantwortungslose Abwertung des Grundsatzes, Texte werden von Autoren verfasst, die dafür auch eine Verantwortung tragen. Nun, meine Schüler könnten als Autor der maschinell erstellten Texte „ChatGPT“ angeben, womit das Problem der Verantwortung, der Autorschaft für den Text aber keinesfalls gelöst ist.

Schließlich ist sich ChatGPT durchaus bewusst, dass er seine Quellen nicht angibt. Daher tendiert sein wissenschaftlicher Wert gegen Null. Die Bemühungen, ihn für die Verwendung im Rahmen einer wissenschaftlichen Arbeit zu retten, werden keinen Erfolg haben. Ohne die Quellengaben sind die Ergebnisse von ChatGPT noch weniger wert als die anonymen Artikel in Wikipedia.

Ja so ist es. Nicht nutzbar. Ohne Quellen nutzlos und ohne jeden Hauch eines wissenschaftlichen Wertes. Jede Hausarbeit, die so daherkommt, hat keinen Wert.https://t.co/OrcCqv4UYT pic.twitter.com/jqg5Ql8JzD

— Heiner Wittmann (@hwromanistik) March 6, 2023

Das zufällige Entstehen eines Textes aufgrund von statistischen Zusammengehörigkeiten hat nichts mit dem Entstehen eines Textes unter der Feder seines Autors zu tun. Natürlich muss man keinesfalls die Biographie eines Autors kennen, um sein Werk zu verstehen, dennoch gilt, was Sartre in Was ist Literatur? über Autor und Leser gesagt hat, dass nämlich nur aus ihrer gemeinsamen Anstrengung dieser imaginäre Gegenstand auftauchen könne, der das Werk des Geistes sei. Ist der Autor eine Maschine, hat er keine Intention, kann sich also nicht mit der Intelligenz des Lesers verbinden, da die Maschine nur viele Wörter in sich trägt, deren Zusammensetzung durch Algorithmen, Statistik, gar auch Zufälle gesteuert wird, nie aber durch Bewusstsein und Stil. Die Maschine hat überhaupt keine Schreibabsicht, sie ist nur darauf programmiert Aufgaben zu erfüllen, selbst ein Praktikant einer Lokalzeitung wird noch mehr von seiner eigenen Einstellung, seines Wissens und seinen Absichten in einen Text packen als ChatGTP dies vermag. Die Bewunderer der künstlichen Sprache, die begierig darauf sind, dass die neue Sprache die menschliche Sprache ersetzen kann, werden vielleicht enttäuscht sein, wenn sie sich genauer ansehen, was ChatGPT und seine Geschwister uns bieten. Noch einmal: ChatGPT kann nicht denken, er rechnet, er sucht nach Wahrscheinlichkeiten, um eine Frage zu beantworten, die man ihm stellt. Gustave Flaubert ging ganz anders vor, indem er sich zum Autor machte, was Jean-Paul Sartre auf 2801 Seiten analysiert hat: seine Sprache, seine Vorstellungswelt, seine Art, seine Neurosen zu überwinden: ChatGPT ist weit entfernt von jeglicher Vorstellungskraft, vgl: Eric Sadin: ChatGPT : « Plus que dans un capitalisme de surveillance, nous voici dans une administration de notre bien-être », dans LE MONDE 19.1.2023

Eric Sadin, Die Stimme gegen den Chat-Bot erheben, Frankfurter Allgemeine Zeitung, 17.2.2023

In den (Lehrer-)Fortbildungen zu ChatGPT wird aktuell die Forderung laut, nicht mehr nur auf die Ergebnisse der Schülerarbeiten zu achten, sondern auch den Weg dahin ins Auge zu fassen und zu bewerten. Will man so das Mogeln mit Hilfe von ChatGPT umgehen? Tatsächlich kann sich ein Problem für die Bewertung von Aufgaben ergeben, da ChatGPT Texte auf Bestellung zu bestimmten Themen liefern kann. Das Internet ist aber voll von Texten, die ebenfalls als Versatzstücke in Referaten landen könnten. So neu ist das Problem also auch wieder nicht.

In den (Lehrer-)Fortbildungen zu ChatGPT wird aktuell die Forderung laut, nicht mehr nur auf die Ergebnisse der Schülerarbeiten zu achten, sondern auch den Weg dahin ins Auge zu fassen und zu bewerten. Will man so das Mogeln mit Hilfe von ChatGPT umgehen? Tatsächlich kann sich ein Problem für die Bewertung von Aufgaben ergeben, da ChatGPT Texte auf Bestellung zu bestimmten Themen liefern kann. Das Internet ist aber voll von Texten, die ebenfalls als Versatzstücke in Referaten landen könnten. So neu ist das Problem also auch wieder nicht.

Das Sprachmodell sei gekommen, um zu bleiben, hört man immer wieder und man erwarte eine stürmische Entwicklung, wobei jeder wie bei einem Pferderennen ständig die Nase vorne haben wolle. Und man vergleicht sein Erscheinen mit dem Aufkommen des Taschenrechners, an den man sich ja auch gewöhnt habe. Mein Taschenrechner war in der Tat eher ein Hilfsmittel, der wenig nützte, wenn man die Aufgabe und den Lösungsweg nicht verstanden hatte. Einer meiner Schüler, der seine Hausaufgabe mit Hilfe von ChatGPT angefertigt hatte, fiel natürlich auf, weil er noch nie so einen langen französischen Text mitgebracht hatte, konnte ihn aber auch bemerkenswert gut vorlesen und übersetzen. Er hatte Hilfe gesucht, gefunden und damit es nicht auffällt, alle Vokabeln gelernt und wohl noch nie so lange und erfolgreich an einer Hausaufgabe gesessen. Und welche Note geben wir ihm?

Und noch was:

Welche Werke hat Hans Mayer (1907-2001) übersetzt?

CHatGPT: „Hans Mayer war ein bekannter deutscher Schriftsteller, Kritiker und Übersetzer, der im Laufe seiner Karriere viele Werke aus dem Englischen ins Deutsche übersetzt hat. Einige der bekanntesten Werke, die er übersetzt hat, sind:

James Joyce’s „Ulysses“ (deutsch: „Ulysses“)

T.S. Eliot’s „The Waste Land“ (deutsch: „Das wüste Land“)

William Faulkner’s „The Sound and the Fury“ (deutsch: „Schall und Wahn“)

Ernest Hemingway’s „For Whom the Bell Tolls“ (deutsch: „Wem die Stunde schlägt“)

D.H. Lawrence’s „Lady Chatterley’s Lover“ (deutsch: „Lady Chatterleys Liebhaber“)“

Es ist jedoch wichtig zu beachten, dass Mayer auch als Literaturkritiker und Autor in seiner Muttersprache Deutsch tätig war und viele Bücher und Aufsätze verfasste.“

ChatGPT hätte besser mal hier nachgesehen: Hans Mayer als Übersetzer www.hans-mayer-gesellschaft.de

Pour la discussion :

Le philosophe @Eric_Sadin appelle à mettre d’urgence des limites à la nouvelle intelligence artificielle ChatGPT, qui peut répondre aux questions des humains rapidement et de manière détaillée, à «décider individuellement et collectivement de nous en détourner». pic.twitter.com/8NZ87QGpUa

— Le Figaro (@Le_Figaro) January 24, 2023

🗣️ « Si l'on adopte ChatGPT et ses avatars aujourd'hui, on se désolera dans quelques années que la moitié de l'humanité soit devenue platiste.» La faillite épistémologique de ChatGPT, une chronique de Gaspard Koenig 👇https://t.co/9xctshXaG4 pic.twitter.com/HCIol0RCdo

— Les Echos (@LesEchos) February 22, 2023